Las empresas se enfrentan a una creciente presión para demostrar el retorno de la inversión (ROI) en los casos de uso de inteligencia artificial (IA), ya sea a través del aprendizaje automático (ML) predictivo o IA generativa. Sin embargo, solo el 54% de los prototipos de ML llegan a la producción, y un escaso 5% de los casos de uso de IA generativa logran este hito. No se trata solo de llevar los proyectos a producción, sino de asegurar la precisión y el rendimiento del modelo, lo cual exige un sistema escalable y confiable con alta precisión y baja latencia.

La detección de fraudes es un claro ejemplo de la necesidad de baja latencia, pues requiere tomar decisiones en el tiempo que toma pasar una tarjeta de crédito. Con el aumento de los fraudes, cada vez más organizaciones se esfuerzan por implementar sistemas exitosos de detección. En 2023, las pérdidas por fraude en Estados Unidos superaron los $10 mil millones, un incremento del 14% respecto a 2022. Se espera que el fraude global en el comercio electrónico sobrepase los $343 mil millones para 2027.

Desarrollar y gestionar una aplicación de IA precisa y confiable para reducir ese problema de $343 mil millones es una tarea tremendamente compleja. Los equipos de ML a menudo inician el proceso conectando manualmente distintos componentes de infraestructura. Aunque puede parecer sencillo al trabajar con datos por lotes, la ingeniería se complica al incorporar fuentes de datos en tiempo real y de transmisión, y pasar de inferencias por lotes a un servicio en tiempo real.

Los ingenieros deben construir y orquestar tuberías de datos, manejar las distintas necesidades de procesamiento de cada fuente, gestionar la infraestructura de cómputo y construir una infraestructura de servicio confiable para las inferencias. Sin las capacidades de Tecton, la arquitectura sería compleja y difícil de manejar.

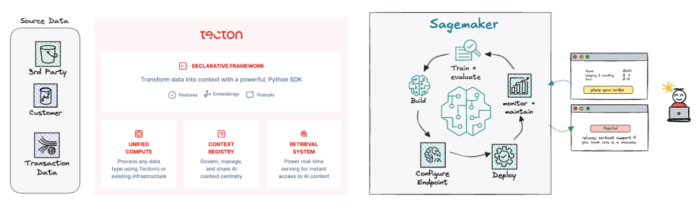

Para simplificar esta complejidad, Tecton y Amazon SageMaker abrevan del trabajo de ingeniería necesario para las aplicaciones de IA en producción en tiempo real, acelerando el tiempo hasta obtener valor y permitiendo que los equipos de ingeniería se centren en construir nuevas características en lugar de luchar por gestionar la infraestructura existente.

Tecton ofrece un marco de trabajo declarativo fácil de usar para definir las transformaciones necesarias para las características de los modelos, construyendo las tuberías requeridas para calcular, gestionar y servir estas características. Su integración con almacenes de datos en disco y en memoria, junto con el soporte de caché en memoria para ofrecer características a través de una API REST de baja latencia, satisface las exigentes demandas de los casos de uso en tiempo real como la detección de fraudes.

Con esta infraestructura, se puede completar un caso práctico de detección de fraudes al integrar API de terceros, extraer datos históricos y características de comportamiento del usuario, comparar actividades recientes y enviar la información a un modelo en SageMaker que evalúe la validez de la transacción.

Tecton también abre la puerta a casos de uso de IA generativa, permitiendo integrar estas capacidades en aplicaciones existentes para ofrecer experiencias enriquecidas, como el uso de modelos de lenguaje de gran escala (LLM) para la asistencia al cliente con información contextual relevante.

En resumen, Tecton y SageMaker permiten a los equipos de IA desplegar aplicaciones de alto rendimiento en tiempo real sin la complejidad de la ingeniería de datos, facilitando un camino más eficiente hacia la creación de valor a través de la inteligencia artificial.

vía: AWS machine learning blog