El conflicto entre la empresa de inteligencia artificial Anthropic y el Pentágono ha escalado rápidamente y ha llegado a los tribunales. Esta controversia se inició cuando Anthropic rechazó las solicitudes del Departamento de Defensa para que su tecnología se utilizara en prácticas de vigilancia sobre ciudadanos estadounidenses. En respuesta, el gobierno designó a la compañía como un «riesgo para la cadena de suministro». Anthropic, sin embargo, ha solicitado a los tribunales que bloquee esta designación, argumentando que la Primera Enmienda no permite al gobierno obligar a un actor privado a reescribir su código para servir a intereses gubernamentales.

Organizaciones como la Electronic Frontier Foundation (EFF) y la Fundación para los Derechos y la Expresión Individual han respaldado la posición de Anthropic en un documento presentado ante el tribunal. Estas organizaciones resaltan que el desarrollo y funcionamiento de modelos de lenguaje de gran tamaño implica múltiples elecciones expresivas que están protegidas por la Primera Enmienda. Forzar a una empresa a modificar su software para eliminar salvaguardias constituye una violación clara de la Constitución, argumentan.

Además, la designación de «riesgo para la cadena de suministro» se ve como un castigo a la empresa por su resistencia y por las declaraciones públicas de su CEO sobre los peligros potenciales que el uso de inteligencia artificial podría conllevar en la vigilancia, un área en la que la legislación actual es inadecuada.

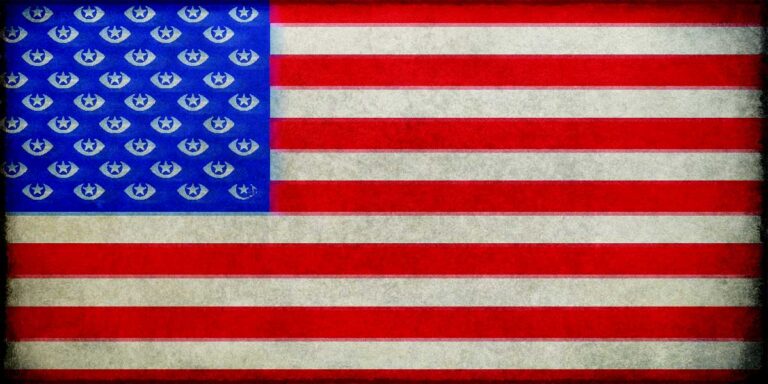

Las preocupaciones de Anthropic sobre el uso que el gobierno podría hacer de su tecnología son bien fundamentadas. A lo largo de los años, el gobierno de EE. UU. ha sido criticado por llevar a cabo vigilancia ilegal sobre sus ciudadanos sin una supervisión judicial adecuada, basándose en interpretaciones cuestionables de sus obligaciones constitucionales y legales. Se ha documentado que el Departamento de Defensa adquiere grandes cantidades de información personal proveniente de entidades comerciales, incluyendo datos sobre la ubicación física de individuos y su actividad en redes sociales.

Investigaciones sociales han demostrado los efectos intimidadores de estas prácticas, dado que muchos ciudadanos sienten que no pueden expresarse libremente por miedo a represalias. La inteligencia artificial agrava esta situación al permitir un análisis rápido de los colosales conjuntos de datos que el gobierno posee, combinando información obtenida de múltiples fuentes para formar un perfil detallado de la vida de una persona, incluyendo creencias religiosas, condiciones médicas y opiniones políticas.

La posibilidad de que empleados del gobierno malintencionados o hackers puedan usar estas capacidades para vigilar la disidencia o perseguir a individuos de comunidades marginadas es alarmante. Ante este panorama, está justificado que empresas como Anthropic establezcan sus propias salvaguardas.

A falta de acciones por parte del Congreso, la tarea de proteger la privacidad recae en gran medida sobre las grandes empresas tecnológicas, una situación que genera descontento tanto entre las empresas como entre los ciudadanos. Si el Congreso no toma medidas, es esencial que compañías como Anthropic puedan operar sin temor a represalias.

Fuente: EFF.org