Los sistemas de recomendación enfrentan un desafío significativo conocido como el «cold start», que no solo se limita a problemas relacionados con nuevos usuarios o nuevos ítems, sino que incluye la total ausencia de señales personalizadas al inicio. Cuando una persona llega por primera vez o aparece contenido nuevo, no existe un historial de comportamiento que permita al motor de recomendaciones identificar los intereses del usuario, lo que resulta en la inclusión de todos en amplios segmentos genéricos. Esto no solo afecta negativamente las tasas de clics y conversiones, sino que también puede alejar a los usuarios antes de que el sistema tenga la oportunidad de aprender sobre sus preferencias. Las soluciones estándares, como el filtrado colaborativo o las listas de popularidad, carecen de la sutileza necesaria para superar esta falta de señales personalizadas, haciendo que sus recomendaciones resulten rápidamente obsoletas.

Imaginemos, sin embargo, un escenario en el que se pueden generar perfiles de interés detallados desde el primer día. Al aprovechar modelos de lenguaje de gran escala, es posible sintetizar ricas representaciones de usuario y artículo (embeddings) sin necesidad de semanas de datos de interacción, transformando un inicio frío en una cálida bienvenida.

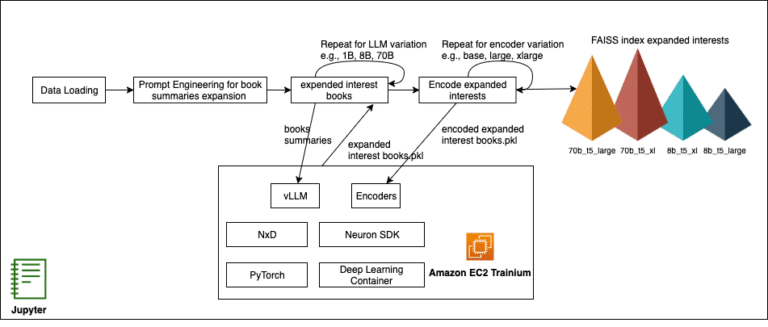

Para ello, se ha diseñado una solución que utiliza chips de Amazon EC2 Trainium, optimizando la implementación de modelos a través de contenedores de aprendizaje profundo (DLC) con el AWS Neuron SDK. Este enfoque permite a los ingenieros de aprendizaje automático experimentar con diferentes configuraciones de LLM y encoders, logrando iteraciones rápidas en métricas de recomendación sin necesidad de modificar el código del modelo base.

En el desarrollo de esta solución, se empleó el conjunto de datos de reseñas de libros de Amazon, que ofrece reseñas de usuarios reales y metadatos de miles de libros. Esto permite simular escenarios de «cold start», donde un nuevo usuario solo tiene una reseña para trabajar. Al utilizar un modelo de lenguaje para enriquecer el perfil del usuario desde datos iniciales limitados, se pueden inferir subtemas relacionados que podría disfrutar el usuario.

El siguiente paso consiste en convertir tanto los intereses expandidos como el catálogo de libros en vectores comparables mediante la utilización de codificadores como Google T5. Se analiza cómo diferentes tamaños de codificadores afectan la calidad de las coincidencias, realizando búsquedas rápidas a través de índices FAISS.

Posteriormente, se mide la calidad de las recomendaciones, revelando que, a medida que se incrementa el tamaño de los modelos, las señales generadas se vuelven más discriminativas para las recomendaciones. Este análisis permite a los desarrolladores determinar la combinación óptima de modelos y codificadores que ofrecen un rendimiento viable sin incurrir en costos excesivos.

Finalmente, se espera implementar estos modelos en un entorno de producción, asegurando que los perfiles de usuario enriquecidos estén listos para conectarse con una mayor cantidad de contenido. Esta iniciativa muestra cómo un uso adecuado de la tecnología de aprendizaje automático puede transformar los sistemas de recomendación, mejorando la experiencia del usuario desde el primer momento.

vía: AWS machine learning blog