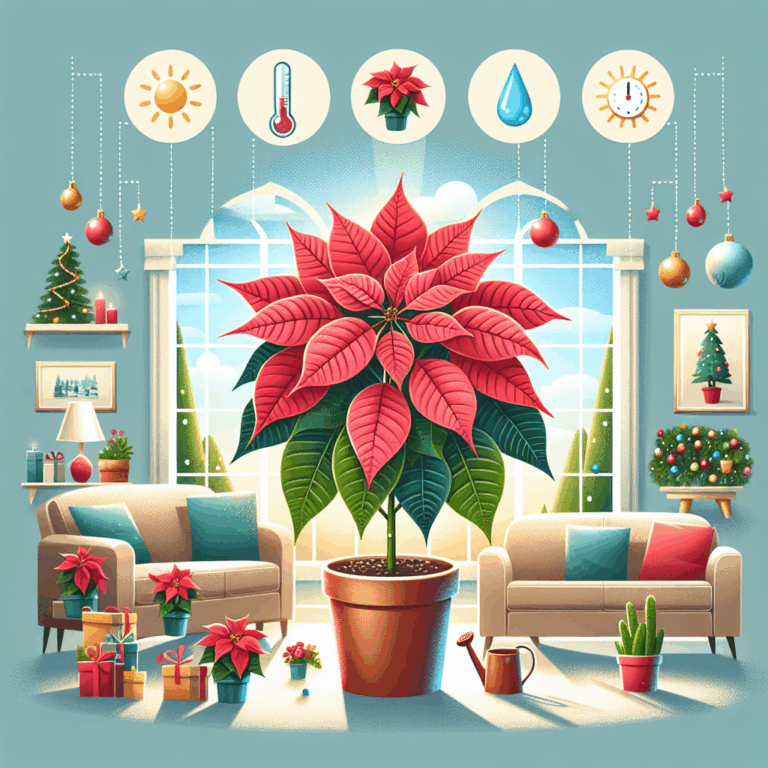

La flor de Pascua, conocida científicamente como Euphorbia pulcherrima, es una de las plantas más emblemáticas de la temporada navideña. Con sus vibrantes bracts rojas y verdes, se ha convertido en un símbolo de la festividad en muchos hogares. Sin embargo, su cuidado adecuado es fundamental para asegurar que esta hermosa planta no solo sobreviva a las celebraciones, sino que también florezca en los meses siguientes.

Para empezar, es esencial elegir el lugar correcto para la flor de Pascua. Esta planta prefiere una ubicación luminosa, pero sin luz solar directa. Un alféizar que reciba luz filtrada es ideal, ya que la exposición directa puede quemar sus hojas. Por otro lado, es fundamental mantenerla alejada de corrientes de aire frío y fuentes de calor, como radiadores o chimeneas, que pueden estresar a la planta.

El riego es otro factor crucial en el mantenimiento de la flor de Pascua. Esta planta disfruta de un sustrato húmedo, pero no en exceso. Es recomendable regarla cuando la parte superior del suelo comience a secarse, asegurándose de que el agua drene bien para evitar el encharcamiento, que puede causar la pudrición de las raíces. Es preferible utilizar agua a temperatura ambiente para no someter a la planta a cambios bruscos.

Además de la humedad, la flor de Pascua agradece un ambiente relativamente húmedo. Si el aire de la casa es muy seco, especialmente en invierno, se puede aumentar la humedad mediante la pulverización de agua sobre sus hojas o colocando la maceta sobre un plato con piedras y agua, asegurándose de que el fondo de la maceta no esté sumergido.

La fertilización también juega un papel importante en la salud de la flor de Pascua. Una vez que ha pasado la época navideña, es recomendable aplicar un fertilizante líquido equilibrado cada dos semanas durante la primavera y el verano, lo cual estimulará un nuevo crecimiento y permitirá que la planta conserve su vigor.

Finalmente, si bien muchas personas consideran la flor de Pascua como una planta de solo una temporada, con los cuidados adecuados, es posible mantenerla viva y saludable durante todo el año. Después de la temporada navideña, se debe permitir que la planta descanse, manteniéndola en un lugar soleado y reduciendo el riego. En el caso de que empiecen a caerse las bracts, es importante no desanimarse. Con paciencia y dedicación, la flor de Pascua puede ser reanimada y florecer nuevamente en la próxima Navidad, llevándose lejos el estigma de ser una planta desechable.