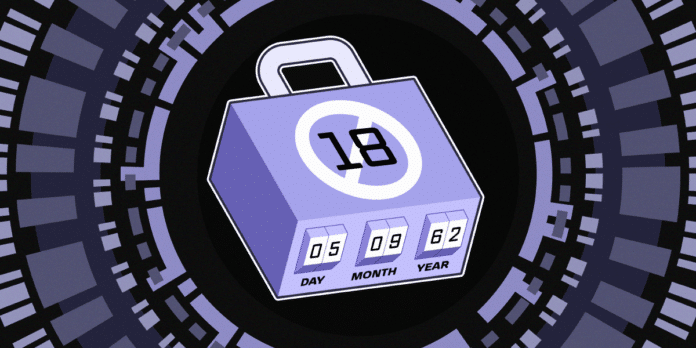

La verificación de la edad en línea se ha convertido en un tema candente en el debate político europeo, especialmente en el contexto de la protección de los menores. A medida que avanzan las discusiones sobre la implementación de medidas de verificación de edad, los expertos advierten que es esencial reflexionar sobre qué problemas específicos se intentan abordar y si las soluciones propuestas son efectivas.

El enfoque actual se basa en tres categorías de riesgos asociados a la seguridad de los menores en línea: los riesgos de contenido, los riesgos de conducta y los riesgos de contacto. Los riesgos de contenido abarcan las implicaciones negativas de la exposición a material inapropiado, como contenido violento o sexualmente explícito. Por otro lado, los riesgos de conducta se refieren a comportamientos potencialmente dañinos que los adolescentes puedan exhibir, como el ciberacoso o la sobreutilización de servicios. Finalmente, los riesgos de contacto están relacionados con la interacción con personas que pueden representar una amenaza, como el grooming.

Sin embargo, muchos expertos señalan que las verificaciones de edad obligatorias son herramientas ineficaces y desproporcionadas. En lugar de restringir numerosos accesos en base a la edad, se podría considerar una aproximación más completa que contemple las dinámicas sociales y el contexto ambiental de los menores en línea. Por ejemplo, un acceso restringido según la edad no necesariamente resuelve los problemas de conducta o los daños derivados del contenido inapropiado; esto se debe a que el comportamiento de los usuarios jóvenes puede estar influenciado más por el diseño de las plataformas y los entornos digitales que por su edad en sí.

Además, obligar a subir documentos identificativos para acceder a contenido en línea plantea serios problemas de privacidad y se convierte en un obstáculo para los adultos, quienes también necesitan acceso a la información. Las medidas de verificación de edad a menudo pasan por alto los derechos fundamentales de privacidad y expresión de todos los usuarios, y no proporcionan una protección real para los menores.

El marco regulatorio de la Unión Europea ha comenzado a girar hacia enfoques basados en la gestión de riesgos, tal como se refleja en la reciente adopción de la Ley de Servicios Digitales (DSA). Esta ley plantea que las plataformas deben implementar medidas de mitigación de riesgos sin necesidad de recurrir a la verificación de edad. Fomentar la elección del usuario, como ofrecer opciones claras sobre moderación de contenido y permitir a los usuarios establecer límites según sus necesidades, es un paso crucial en la dirección correcta.

En este sentido, es fundamental resguardar la privacidad de los jóvenes mediante la limitación de la recopilación de datos y la prohibición de la publicidad conductual. La regulación actual ya prohíbe la publicidad dirigida a menores basada en su comportamiento, pero iniciativas más amplias, como una prohibición total de dicha práctica, se plantean como una solución efectiva para reducir la recogida de datos.

La escala del desafío exige un enfoque multifacético. Abogar por la privacidad, mejorar la autonomía de los usuarios y construir un sistema de moderación de contenido que respete los derechos de todos son pasos cruciales para navegar el complejo entorno digital actual. La seguridad de los menores en línea involucra no solo herramientas tecnológicas, sino también una estrategia que considere sus derechos y el impacto de las decisiones políticas en su desarrollo y bienestar.

Fuente: EFF.org