En el ámbito del desarrollo de la inteligencia artificial (IA) y el aprendizaje automático (ML), Amazon Web Services (AWS) ha dado un paso significativo al integrar SageMaker con MLflow, una herramienta de código abierto ampliamente utilizada para organizar, rastrear y analizar experimentos de IA generativa y ML. Esta colaboración entre SageMaker y MLflow simplifica las complejas tareas de experimentación en el ámbito del aprendizaje automático, ofreciendo a los científicos de datos una forma más segura y eficiente de avanzar en sus proyectos.

El enfoque principal de esta integración es proporcionar un entorno gestionado que permita a los usuarios configurar, administrar, analizar y comparar sus experimentos de ML con mayor facilidad. Al adoptar SageMaker, que es un servicio ML totalmente gestionado, los usuarios pueden aprovechar un flujo de trabajo completo para sus modelos de ML, desde la construcción hasta el entrenamiento. A través de esta combinación con MLflow, ahora es posible gestionar múltiples experimentos, permitiendo a los científicos de datos reproducir y comparar resultados de manera más sencilla.

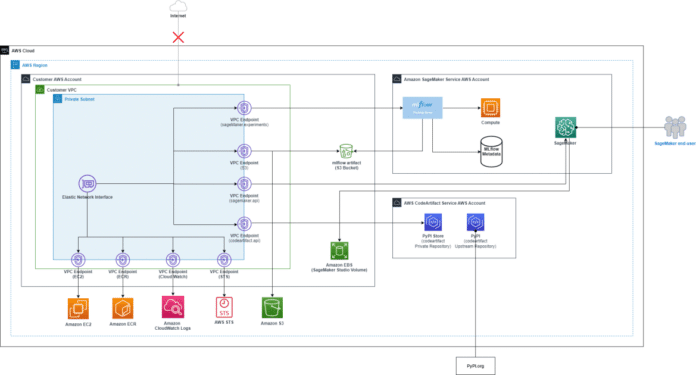

La seguridad es una de las preocupaciones primordiales en la gestión de datos críticos. Con la capacidad de ejecutar SageMaker en un Amazon Virtual Private Cloud (VPC), los usuarios pueden controlar el acceso a la red y establecer conectividad a Internet de manera segura, minimizando los riesgos de acceso no autorizado. Además, la compatibilidad con AWS PrivateLink permite la transferencia de datos críticos desde el VPC a los servidores de seguimiento de MLflow, garantizando que la transmisión de información sensible se realice dentro de la red de AWS, lejos de la exposición a Internet pública.

El empleo de la infraestructura mediante el AWS Cloud Development Kit (CDK) permite a los usuarios desplegar un entorno completo de forma rápida. Este enfoque no solo facilita la instalación de MLflow en un entorno seguro, sino que también permite a las empresas y desarrolladores concentrarse en la mejora continua de sus modelos y experimentos sin preocuparse por las complejidades técnicas de la configuración del entorno.

AWS también ha introducido medidas para fortalecer la privacidad al permitir la creación de dominios y repositorios en CodeArtifact, lo cual forma una importante parte del ecosistema que sostiene los experimentos de ML. Junto con estas capacidades, Amazon SageMaker puede ahora realizar experimentos de ML en un entorno sin acceso a Internet, utilizando la biblioteca PyPI de manera interna.

Este desarrollo, respaldado por la última versión de MLflow, promete acelerar los flujos de trabajo de ML y AI generativa desde la experimentación hasta la producción, proporcionando un sistema robusto y seguro para las empresas que buscan sacar el máximo provecho de sus inversiones en inteligencia artificial. Al cerrar la brecha entre la seguridad y la innovación, AWS reafirma su compromiso de ofrecer soluciones de ML ágiles y confiables que contribuyan al avance de la inteligencia artificial responsable y ética.

vía: AWS machine learning blog