En un mundo donde la inteligencia artificial (IA) se está volviendo cada vez más relevante, la técnica de Generación Aumentada por Recuperación (RAG) ha emergido como un componente esencial para mejorar la precisión y relevancia de las respuestas generadas por los modelos de lenguaje de gran escala (LLM). La clave de RAG radica en la calidad del contexto proporcionado al modelo de lenguaje, generalmente obtenido de almacenes vectoriales según las consultas del usuario.

Uno de los métodos más eficaces para mejorar la relevancia del contexto es a través del filtrado de metadatos. Esta técnica permite refinar los resultados de búsqueda mediante un pre-filtrado del almacén vectorial basado en atributos de metadatos personalizados, reduciendo así el ruido y la información irrelevante.

En ciertos casos de uso, especialmente aquellos que implican consultas complejas o un gran número de atributos de metadatos, la construcción manual de filtros de metadatos puede ser un desafío. Para enfrentar estos obstáculos, los modelos de lenguaje de gran escala pueden emplearse para crear una solución robusta a través de un enfoque conocido como filtrado inteligente de metadatos.

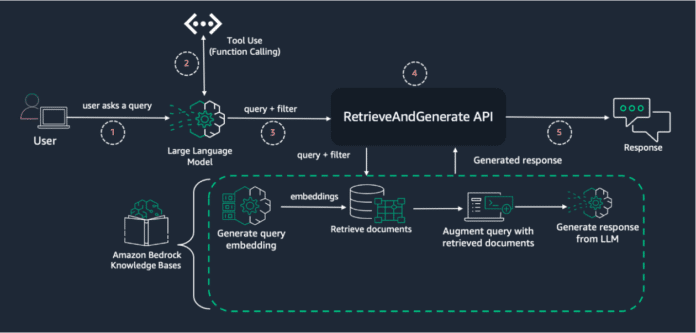

Este enfoque, implementado por Amazon a través del servicio Bedrock, permite utilizar modelos de lenguaje para extraer dinámicamente filtros de metadatos a partir de consultas en lenguaje natural. Esto se logra gracias a la capacidad de las herramientas de llamado de funciones, que permiten a los modelos de lenguaje interactuar con herramientas o funciones externas, mejorando su capacidad para procesar y responder a consultas complejas.

Amazon Bedrock, un servicio completamente gestionado, ofrece una selección de modelos fundacionales de alto rendimiento de empresas líderes en IA mediante una única API. Una de sus características principales, las Bases de Conocimiento de Amazon Bedrock, ofrece una capacidad RAG completamente gestionada, que ahora admite potentes capacidades de filtrado de metadatos.

Implementar el filtrado dinámico de metadatos puede mejorar significativamente las métricas clave de un sistema RAG: la relevancia de las respuestas, el recuerdo del contexto y la precisión del contexto. La integración de Amazon Bedrock junto con modelos de datos Pydantic para la validación y estructuración de datos permite extraer entidades de forma dinámica y estructurar filtros de metadatos que optimizan el proceso de recuperación de información.

El proceso comienza con la consulta del usuario procesada por un modelo de lenguaje que extrae los metadatos relevantes. Estos se utilizan para construir un filtro de metadatos adecuado que mejora la relevancia de los documentos recuperados del sistema de conocimiento.

El filtrado inteligente de metadatos a través de Amazon Bedrock no solo simplifica el proceso de construcción de filtros, sino que también demuestra cómo se pueden crear aplicaciones RAG más eficaces y amigables para el usuario, permitiendo consultas en lenguaje natural más intuitivas. Así, las respuestas generadas son más precisas y relevantes, ajustándose mejor a las necesidades de los usuarios.

vía: AWS machine learning blog