Amazon ha lanzado una nueva funcionalidad de su plataforma Amazon SageMaker, que permite a los usuarios crear, entrenar y desplegar modelos de aprendizaje automático (ML) de manera escalable y personalizada. Este avance es especialmente significativo para sectores que requieren soluciones a medida, como análisis geoespacial, investigaciones en bioinformática o modelos de aprendizaje automático cuántico.

SageMaker ahora permite a los desarrolladores extender su funcionalidad a través de contenedores personalizados, lo que significa que pueden incluir sus propios modelos y dependencias de software no disponibles en las imágenes de contenedor administradas por SageMaker. En una guía reciente, se adopta el modelo Prithvi de la NASA, el cual ha sido desarrollado en colaboración con IBM. Este modelo se basa en arquitectura de transformadores de visión temporal y ha sido entrenado utilizando datos de Landsat y Sentinel 2.

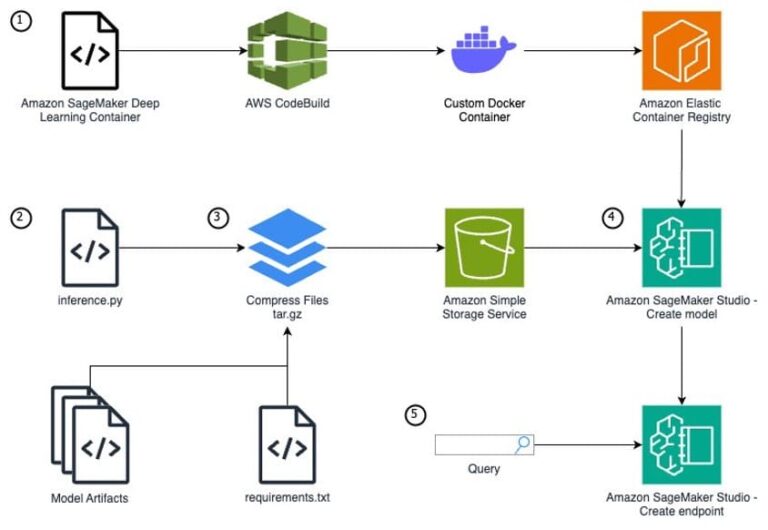

El modelo Prithvi puede ser ajustado para realizar tareas como la detección de cicatrices por incendios, la clasificación de cultivos y la cartografía de inundaciones, gracias al uso de la biblioteca mmsegmentation. Para implementar este tipo de modelos personalizados en SageMaker, es necesario seguir un proceso que incluye la creación de definiciones de modelos personalizadas, la preparación de artefactos y archivos de inferencia estructurados adecuadamente, y la carga de estos elementos en Amazon S3.

Un aspecto destacado de estas nuevas capacidades es la posibilidad de integrar librerías y paquetes adicionales que no se encuentran en las imágenes de contenedor estándar. Esto permite a los investigadores y a los desarrolladores de modelos tener un control total sobre el ambiente y las dependencias de su modelo.

Para desplegar un modelo en SageMaker, los usuarios deben construir una imagen de contenedor que incluya el modelo y sus dependencias, crear un archivo de especificación de compilación, y posteriormente realizar una serie de pasos a través de la interfaz de Amazon SageMaker Studio. Una vez creada la infraestructura, es posible probar la endpoint de inferencia creando casos de prueba que envían imágenes a ser procesadas y reciban predicciones en tiempo real.

Este avance refuerza el compromiso de Amazon con la innovación en el ámbito del aprendizaje automático, ofreciendo a desarrolladores e investigadores herramientas eficaces y personalizables que facilitan la implementación de soluciones complejas. A medida que el uso de la inteligencia artificial y el análisis de datos sigue creciendo, SageMaker se posiciona como una plataforma clave para el desarrollo y despliegue de modelos de machine learning adaptados a necesidades específicas.

vía: AWS machine learning blog